Wprowadzenie

XX wiek był okresem intensywnych przemian przemysłowych, technologicznych i społecznych. Często w literaturze (zwłaszcza ekonomicznej) nazywany jest Drugą rewolucją przemysłową, która charakteryzowała się upowszechnieniem elektryczności, silnika spalinowego i telefonii. Nastąpił rozwój przemysłu chemicznego, stalowego i motoryzacyjnego. Między innymi dzięki elektryfikacji wprowadzano maszyny do produkcji na dużą skalę, a to zmniejszyło zapotrzebowania na pracę fizyczną i podniosło wzrost efektywności gospodarek.

Jest to czas, w którym naukowcy zaczęli się zastanawiać czy można całkowicie zautomatyzować produkcję kierowaną przez „sztuczny mózg”? I tak w roku 1921 czeski dramaturg Karel Capek opublikował sztukę science fiction „Uniwersalne? Roboty Rossuma”, która wprowadziła pojęcie „sztucznych ludzi” nazwanych robotami. Można to uznać za pierwsze użycie tego słowa. Dalej w 1929 r. japoński profesor Makoto Nishimura zbudował pierwszego japońskiego robota o nazwie Gakutensoku. w swoich publikacjach 1949 r. informatyk Edmund Callis Berkley opublikował książkę „Gigantyczne mózgi, czyli maszyny, które myślą”, porównując nowsze modele komputerów do ludzkich mózgów. Rok później, bo w 1950 Alan Turing opublikował „Computer Machinery and Intelligence”, w którym zaproponował test maszynowej inteligencji, znany jako Gra w Imitację. W roku 1952 informatyk o imieniu Arthur Samuel stworzył program do gry w warcaby, który jako pierwszy nauczył się tej gry samodzielnie. Zaś w roku 1955 John McCarthy zorganizował warsztaty na Uniwersytecie Dartmouth na temat „sztucznej inteligencji”, w których pierwszy raz użyto tego terminu (Uniwersytet Szczeciński, b.d.).

Dalsze lata to gwałtowny wzrost zainteresowania i rozwoju sztucznej inteligencji, określany jako „boom AI” (lata 1980-87). I po okresie stagnacji w rozwoju sztucznej inteligencji (zbyt wysokie koszty w stosunku do korzyści) nastąpił gwałtowny jej rozwój trwający do dzisiaj.

Jak piszą Dominika Skoczylas i Paweł Księżak w swoich publikacjach ten dynamiczny rozwój cyfrowej technologii wzbudził wiele wyzwań natury etycznej i prawnej z uwagi na skalę i różnorodność jej zastosowania. Przedmiotem dyskursu są przede wszystkim zagadnienia prawa ochrony konkurencji i konsumentów, ochrony danych osobowych, odpowiedzialności cywilnej i prawa kontraktów.

Wśród zidentyfikowanych zagrożeń związanych z rozwojem i wdrażaniem nowych technologii wskazuje się m.in. ryzyko działań o charakterze dyskryminacyjnym, wynikających z naruszenia prywatności jednostek, pogłębiania wykluczenia cyfrowego, wzrostu nierówności społecznych oraz potencjalnego wzrostu bezrobocia (Skoczylas, 2025; Księżak, 2021). Według Adama Wiśniewskiego (2023), technologie te mogą również wpływać negatywnie na realizację praw podstawowych oraz dobrostan człowieka, m.in. poprzez generowanie stronniczych treści, wspieranie dyskryminujących narracji, nadmierną inwigilację, ograniczanie wolności wypowiedzi oraz naruszanie zasady równości.

Ryzyka związane z niekontrolowanym rozwojem elektroniki oraz informatyki wymagają odrębnych uregulowań prawnych. I tak Piotr Burczaniuk w swoich pracach podkreśla, że początek działań prawodawczych w tym obszarze dostarczyły różnego rodzaju akty prawa miękkiego, pochodzące zarówno od podmiotów zaangażowanych w tworzenie rozwiązań opartych o SI (samoregulacja), jak i organizacji typu non-profit, zajmujących się problematyką nowych technologii, czy też samych organizacji międzynarodowych, podejmujących przedmiotową tematykę z uwagi na zakres własnych celów działania (Burczaniuk, 2024).

Po trzech latach pracy 21 maja 2024 r. Rada Europejska zatwierdziła projekt tzw. Aktu w sprawie sztucznej inteligencji (AI Act), który wszedł w życie 1 sierpnia 2024, stając się rzeczywistością prawną Unii Europejskiej.

W artykule 3 zdefiniowano Sztuczną Inteligencję (SI) lub AI (ang. artificial intelligence), jako:

„system sztucznej inteligencji ogólnego przeznaczenia" oznacza system sztucznej inteligencji oparty na modelu sztucznej inteligencji ogólnego przeznaczenia i zdolny do służenia różnym celom, zarówno do bezpośredniego użytku, jak i do integracji z innymi systemami sztucznej inteligencji" oraz określono:

„umiejętności w zakresie sztucznej inteligencji" oznaczają umiejętności, wiedzę i zrozumienie, które pozwalają dostawcom, podmiotom wdrażającym i osobom dotkniętym problemem, z uwzględnieniem ich odpowiednich praw i obowiązków w kontekście niniejszego rozporządzenia, na świadome wdrażanie systemów sztucznej inteligencji, a także na uzyskanie świadomości na temat szans i zagrożeń związanych ze sztuczną inteligencją oraz możliwych szkód, jakie może ona wyrządzić" (AI Act, 2024).

Akt ten oparty jest na trzech wymogach stawianych SI:

1) jej zgodności z prawem obowiązującym (ze szczególną rolą ochrony prywatności, w tym danych osobowych);

2) zgodności z zasadami etycznymi;

3) solidności technicznej i społecznej.

Konieczność ich stosowania przez dostawców, importerów, dystrybutorów, jak i samych użytkowników ma zapewnić wykonanie celu nadrzędnego jakim jest oparcie SI na wartościach i prawach podstawowych, na czele z godnością ludzką i ochroną prywatności (Wiśniewski, 2023; Burczaniuk, 2024; Skoczylas, 2025).

Do praw chronionych w AI Act wpisanych w artykułach niżej wymienionych należą: (Art. 1) prawo do godności człowieka, (Art. 7 i Art. 8) poszanowanie życia prywatnego i ochrona danych osobowych, (Art. 11) zapobieganie ograniczaniu prawa do wolności wypowiedzi, (Art. 12) zapobieganie ograniczaniu prawa do wolności zgromadzania się, (Art. 21) niedyskryminację, (Art. 23) równość kobiet i mężczyzn, (Art. 24) prawa dziecka – które wymagają uwzględnienia wrażliwości dzieci oraz zapewnienia im ochrony i opieki niezbędnej dla ich dobrostanu, (Art. 26) integrację osób niepełnosprawnych, (Art. 28) wysoki poziom ochrony konsumentów, (Art. 31) prawa pracowników do należytych i sprawiedliwych warunków pracy – z uwagi na możliwe szkody, jakie może spowodować system sztucznej inteligencji, w tym w odniesieniu do zdrowia i bezpieczeństwa ludzi, także podstawowe prawo do wysokiego poziomu ochrony środowiska, (Art. 47 i Art. 48) zapewnienie ochrony prawa do skutecznego środka prawnego i dostępu do bezstronnego sądu, prawa do obrony i domniemania niewinności, jak również ogólnej zasady dobrej administracji.

Podstawą tworzenia AI Act była zasada ryzyka, kwalifikująca systemy SI od zależności zidentyfikowanych zagrożeń i związanych z nimi niebezpieczeństw, jakie mogą generować dla praw i wolności podmiotów, które będą korzystać z tej technologii, a w szczególności ich użytkowników. Uwzględniając definicję ryzyka jako prawdopodobieństwa powstania szkody / (niepożądanych) skutków w AI Act: „ryzyko" oznacza połączenie prawdopodobieństwa wystąpienia szkody i stopnia tej szkody), wprowadzono cztery poziomy ryzyka dla oddziaływania SI:

1. niedopuszczalnego (tytuł II rozdział 1 AI Act), realizujących zakazane praktyki, zapisane w Art. 5, które obejmują:

a) stosowanie technik podprogowych (manipulacyjnych);

b) wykorzystywanie dowolnych słabości określonej grupy osób;

c) dokonywanie oceny lub klasyfikacji osób fizycznych prowadzonej przez określony czas wywołujących określone skutki;

d) wykorzystywania w przestrzeni publicznej przez organy ścigania lub w ich imieniu, systemów zdalnej identyfikacji biometrycznej „w czasie rzeczywistym” do celów egzekwowania prawa.

2. wysokiego (tytuł III rozdział 2 i 3 AI Act), sklasyfikowane w załączniku do rozporządzenia, wobec których zakłada się konieczność spełnienia ustanowionych w nim wymogów, w szczególności w zakresie zarzadzania ryzykiem, wykorzystywania i zarządzania danymi, rejestrowania zdarzeń, udostępniania informacji użytkownikom, nadzoru przez człowieka czy też dokładności, solidności i cyberbezpieczeństwa.

3. ogólnego, utożsamione z tzw. systemami ogólnego przeznaczenia (niebędącymi systemami wysokiego ryzyka), wobec których wprowadzone zostaną określone obowiązki wobec ich dostawców, czy też w zakresie posiadania deklaracji zgodności UE.

4. braku ryzyka, pozostałe systemy SI bez nałożonych wymogów (Burczaniuk, 2024).

W literaturze przedmiotu rozwój technologii opartej na SI oceniany jest pozytywnie jako m.in. wzrost efektywności, szybszy dostęp do informacji czy usługi on-line, ale są one wzmiankowane już jako negatywne skutki o charakterze prawnym, technologicznym, społecznym i etycznym, a nawet teologicznym, co stanowi istotne zagrożenie dla bezpieczeństwa człowieka (Wornalkiewicz, 2024).

Wspomniane już wyżej zagrożenia mogą pojawiać się na etapie powstawania produktów, ich dystrybucji i użytkowania. Rozwój technologii cyfrowych wiąże się z szeregiem zagrożeń o charakterze systemowym i społecznym, wśród których wymienia się m.in. zwiększone ryzyko ataków hakerskich, rozpowszechnianie dezinformacji, możliwość paraliżu infrastruktury krytycznej oraz pogłębianie zjawiska wykluczenia cyfrowego.

Szczególną uwagę AI Act poświęca deepfake (jest to wygenerowany lub zmanipulowany obraz, treść audio lub wideo, która przypomina istniejące osoby, obiekty, miejsca, podmioty lub zdarzenia i które mogą błędnie wydawać się innej osobie jako autentyczne lub prawdziwe), systemom identyfikacji biometrycznej czy szczególnym kategoriom danych osobowych. Act wprowadza „element bezpieczeństwa" oznaczający element produktu lub systemu SI, który spełnia funkcję bezpieczeństwa tego produktu lub systemu SI lub którego awaria lub nieprawidłowe działanie zagraża zdrowiu i bezpieczeństwu osób lub mienia wraz z dla organów nadzoru (np. Biuro ds. sztucznej inteligencji) czy właściwy organ krajowy (oznaczający organ notyfikujący lub organ nadzoru rynku; w odniesieniu do systemów sztucznej inteligencji wprowadzonych do użytku lub wykorzystywanych przez instytucje, agencje, urzędy i organy Unii odniesienia do właściwych organów krajowych lub organów nadzoru rynku w niniejszym rozporządzeniu należy interpretować jako odniesienia do Europejskiego Inspektora Ochrony Danych) (AI Act, 2024).

Autorzy tacy jak cytowana już Dominka Skoczylas (specjalizująca się m.in. w cyberbezpieczeństwie) czy Przemysław Polański (jeden z czołowych ekspertów w Polsce w zakresie europejskiego i międzynarodowego prawa nowych technologii) w swoich publikacjach poświęconych nowym technologiom są zgodni, że SI ma szanse zagwarantować dobrostan człowieka jako technologia wspierająca działalność człowieka a nie wykluczająca go ze środowiska (Skoczylas, 2025; Luigi, 2020).

Dobrostan człowieka (ang. well-being) to wielowymiarowy konstrukt psychologiczny i społeczny, który odnosi się do ogólnej jakości życia jednostki, jej zdrowia psychicznego, emocjonalnego, fizycznego oraz relacji społecznych. To także dobre samopoczucie w pracy, spełnienie fizycznych, psychicznych, społecznych i poznawczych potrzeb i oczekiwań pracownika związanych z wykonywaną pracą (ISO 45003, 2021). Środowisko pracy rozumiane jest jako przestrzeń, w której pracownik lub zespoły pracownicze świadczą pracę, bezpośrednio wpływają na ich kondycję mentalną, a jakość pracy, zaangażowanie i efektywność w dużej mierze wynika z ogólnego dobrostanu (Milewski, 2023).

W ujęciu Światowej Organizacji Zdrowia (WHO), dobrostan jest definiowany jako „stan pełnego fizycznego, psychicznego i społecznego dobrostanu, a nie tylko brak choroby lub kalectwa” (WHO, 1948).

„...epoka nowych technologii, jeżeli zostanie ukształtowana w sposób wrażliwy i odpowiedzialny, stanie się katalizatorem dla nowego kulturowego renesansu (...) – prawdziwej globalnej cywilizacji. Czwarta rewolucja przemysłowa może wprawdzie doprowadzić do zrobotyzowania ludzkości, co naruszy nasze tradycyjne źródła sensu – pracę, społeczność, rodzinę i tożsamość.

Mamy jednak szansę wykorzystać ją tak, by ludzkość osiągnęła poziom nowej, zbiorowej i moralnej świadomości, opartej na wspólnym poczuciu przeznaczenia. Do nas wszystkich należy zadbanie, by ziściła się ta druga możliwość” (Schwab, 2018).

Sztuczna Inteligencja a miejsca pracy

Przemysł 4.0 jest dziełem myśli człowieka dążącego do automatyzacji produkcji, eliminowania lub ograniczania pracy ludzkiej, szczególnie przy pracach monotonnych, opartych na czynnościach powtarzalnych. Cyfryzacja ma wspomagać prace wymagające precyzji, niwelując błędy operatora (na przykład roboty medyczne), czy dokonywać w krótkim czasie skomplikowanych analiz, które mają wspomóc zarządzanie biznesem (Kochańska, 2025).

Dynamiczny rozwój technologii informatycznych, w tym sztucznej inteligencji, zmienia sposób funkcjonowania miejsc pracy na całym świecie. Sztuczna inteligencja to subdyscyplina nauk komputerowych zajmująca się tworzeniem systemów informatycznych, które potrafią uczyć się i działać autonomicznie (Piwowar i in., 2023), które mogą być wykorzystywane w takich obszarach działania człowieka:

1) w sądownictwie,

2) w logistyce,

3) w procesie produkcji wyrobów,

4) w poszukiwaniu i wydobywaniu złóż,

5) w budownictwie,

6) w ochronie zdrowia,

7) w szeroko rozumianej ekonomii i rachunkowości,

8) w edukacji,

9) w systemach bezpieczeństwa,

10) w poszukiwaniu informacji (Wornalkiewicz, 2024).

Według raportu Artificial Intelligence Index Report z 2023 roku wynika, że obszarami oddziaływania SI na gospodarkę, politykę i społeczeństwo, są: rozwój nauki, wzrost zapotrzebowania na rynku pracy na osoby z kompetencjami związanymi ze sztuczną inteligencją oraz wykorzystanie SI do ograniczania kosztów i zwiększania zysków w przedsiębiorstwach. Według PwC, która już w 2018 r. szacowała, że rozwój technologii sztucznej inteligencji do 2030 roku przyniesie wzrost globalnego PKB nawet o 14%, będzie to rezultatem wielu ulepszeń i optymalizacji, które możliwe będą dzięki wykorzystaniu SI. Przede wszystkim przyczynią się do tego procesy automatyzacji metod analiz biznesowych, szczególnie rutynowych i powtarzalnych zadań. Cyfryzacja procesów pozwoli na efektywniejsze wykorzystanie istniejących zasobów i pozwoli na zwiększenie produktywności. Odnosi się to także do optymalizacji decyzji biznesowych. Istotną kwestią jest stosowanie i wykorzystanie SI w przedsiębiorstwach, bowiem pozwala ona na zmniejszenie kosztów, czy to poprzez optymalizację dotychczasowych inwestycji, czy też uszczelnienie przepływu pieniędzy (Piwowar i in., 2023).

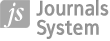

Menadżerowie przedsiębiorstw widzą zastosowanie SI w poprawie cech, funkcji i wydajności ich produktów (51%), ale także w odciążeniu pracowników, by zwiększyć ich efektywność dzięki automatyzacji zadań (36%) a także w podejmowaniu lepszych decyzji (dostęp do większej bazy danych – 35%). Szczegółowe dane zawarte są na rycinie 1.

Rycina 1

Procent menadżerów, którzy podają następujące zalety sztucznej inteligencji

Żródło: (Davenport, Ronanki, 2018).

Pracodawcy coraz chętniej inwestują w systemy wspierane przez SI, dostrzegając w nich potencjał nie tylko do poprawy wydajności, ale również do troski o zdrowie i dobrostan pracowników (Davenport, Ronanki, 2018).

Przedsiębiorcy zaczynają mieć trudności z nadmierną fluktuacją kadr, trudnymi rekrutacjami oraz utrzymaniem kluczowych pracowników. Z „Raportu: Kondycja psychiczna polskich pracowników”, w którym zawarto dane z badania Pracuj.pl i Pracuj Ventures „Zmiany w polskim HR okiem HR-owców 2023” wynika, że aż 77% pracodawców odczuwa problem ze znalezieniem pracowników (Milewski, 2023).

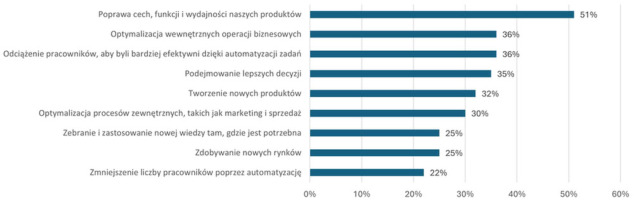

Pracownicy i pracodawcy zgadzają się, że takie czynniki jak wynagrodzenie, obniżony nastrój, atmosfera w pracy, trudności finansowe i problemy rodzinne wpływają na efektywność pracy. Dane zawarto na rycinie 2.

Należy pamiętać, że przedsiębiorstwa tworzą kulturę organizacyjną, która oddziałuje na kulturę bezpieczeństwa, a ta przekłada się nie tylko na wydajność pracowników, ale także w ich zaangażowanie oraz świadomość istniejących ryzyka, które staje się szansą i wyzwaniem.

To właśnie kultura bezpieczeństwa postrzega pracownika nie tylko w procesie pracy, w życiu zawodowym, ale także w otoczeniu rodzinnym i społecznym.

Dlatego wiele jednostek organizacyjnych buduje swoją działalność na pięciu filarach strategii dobrostanu. Są to:

1) kultura organizacyjna,

2) programy zdrowotne i wellness,

3) elastyczność w pracy,

4) rozwój zawodowy,

5) skuteczna komunikacja i feedback (Kruczek, Sekułowicz, 2024).

Rycina 2

Aspekty mogące mieć negatywny wpływ na efektywność w pracy

Źródło: opracowanie własne na podstawie (Milewski, 2023).

SI jest stale obecna w naszym codziennym życiu. Jej rozwój może być dla niektórych zaskoczeniem, jednak jest to proces, którego się już nie da zatrzymać. Rozwiązania SI stają się integralną częścią także w miejscach pracy, wspomagając wspomniane już procesy decyzyjne, analizy danych, automatyzując rutynowe zadania oraz dostarczając narzędzi do tworzenia innowacyjnych rozwiązań (Welbeing Polska, 2023). Szybkość z jaką można otrzymać interesujące użytkownika dane oraz ich powszechna dostępność przyspieszyła procesy decyzyjne i tempo pracy. Aż 97% badanych pracowników stwierdziło, że w latach 2020-2023 pogorszył się ich stan zdrowia psychicznego (Milewski, 2023). Jest to efekt ilości docierających do człowieka informacji i tempa pracy.

Szczególnie praca zdalna wiąże się z izolacją społeczną i trudnościami związanymi z oddzieleniem zadań wykonywanych w ramach stosunku służbowego a życiem prywatnym i odpoczynkiem. „Zaoszczędzony” czas na dojazdy do miejsc pracy wykorzystywany jest na świadczenie pracy, stąd dzień roboczy z 8 godzin (w tym 15 minut przerwy – standard według ustawy Kodeks pracy z dnia 26 czerwca 1974 r.) wydłuża się. Pracownik ciągle jest w trybie „on-line”, nie mając czasu na efektywny odpoczynek. Przede wszystkim na regenerujący sen, aktywność fizyczną, adekwatną dietę do siedzącego trybu życia. Wśród pracowników pracujących w domach zauważono niekorzystnie relacje między członkami rodziny, które obniżyły poczucie satysfakcji z pracy oraz znacząco wpłynęło na ich produktywność i wydajność w pracy bezpośrednio obniżając dochody całej rodziny (Bartczak, 2020).

Jedną z przyczyn takiego stanu rzeczy upatruje się w tzw. zjawisku „zmęczenia / przemęczenia cyfrowego”. Cyfrowe zmęczenie definiuje się jako fizyczne i psychiczne wyczerpanie związane z nadmierną ekspozycją na technologie cyfrowe (ekrany, komputery itp.). Występuje wówczas, kiedy dana osoba intensywnie korzysta z narzędzi technologicznych w swojej pracy lub życiu osobistym. Ta nadmierna interakcja z maszynami prowadzi do nasycenia poznawczego. Mózg musi stale odbierać i przetwarzać wiele informacji, co nadmiernie go obciąża. Rezultatem jest uczucie przytłoczenia, niezdolność do przyswajania nowych danych. Cyfrowe zmęczenie ma wiele różnych objawów. Obejmują one, w dowolnej kolejności, problemy z koncentracją i pamięcią, drażliwość, bóle głowy, nadwrażliwość na hałas, niepokój, zaburzenia snu i obniżoną motywację. Długotrwale odczuwane objawy mogą prowadzić do wypalenia zawodowego (Knowmore, b.d.).

Stąd potrzebne są działania, przede wszystkim organizacji pracowniczych, które mogą być wspomagane przez państwo (np. wprowadzenie pilotażu skróconego czasu pracy), mające na celu poprawę dobrostanu pracowników oraz na zachowanie równowagi emocjonalnej i psychicznej (MRPiPS, 2025).

Wyzwania i zagrożenia związane z wdrożeniem sztucznej inteligencji w miejscu pracy

Pomimo licznych korzyści wynikających z implementacji sztucznej inteligencji w procesach analizy ryzyka zachowań pracowników, jej zastosowanie rodzi szereg wyzwań natury technicznej, społecznej, etycznej oraz związanej z cyberbezpieczeństwem. Do najczęściej wskazywanych zagrożeń należą:

Problemy z ochroną prywatności – gromadzenie, przetwarzanie i analiza danych osobowych pracowników budzą uzasadnione obawy dotyczące naruszenia ich prawa do prywatności oraz możliwości nieuprawnionego wykorzystania informacji wrażliwych.

Nadmierna kontrola i monitoring – intensywne stosowanie narzędzi nadzorujących może prowadzić do pogorszenia dobrostanu psychicznego pracowników, wzrostu poziomu stresu, poczucia braku autonomii oraz obniżenia zaufania wobec pracodawcy.

Ryzyko automatyzacji i redukcji zatrudnienia – rozwój algorytmicznych systemów decyzyjnych może skutkować eliminacją niektórych stanowisk pracy, co z kolei prowadzi do niepewności zatrudnienia i pogłębiania nierówności społecznych.

Problemy etyczne – wdrażanie SI w środowisku pracy rodzi pytania o sprawiedliwość algorytmiczną, przejrzystość procesów decyzyjnych oraz odpowiedzialność za skutki działania systemów. Istnieje ryzyko uprzedzeń zakodowanych w danych treningowych, które mogą prowadzić do dyskryminujących decyzji wobec pracowników, a także brak mechanizmów umożliwiających skuteczne odwołanie się od decyzji podejmowanych przez systemy SI.

Zagrożenia dla cyberbezpieczeństwa – integracja SI z systemami informatycznymi przedsiębiorstw zwiększa powierzchnię potencjalnych ataków cybernetycznych. W szczególności narażone są systemy gromadzące dane pracownicze, które mogą stać się celem działań hakerskich, prowadzących do wycieku danych, paraliżu infrastruktury lub manipulacji informacjami. Ponadto, nieodpowiednio zabezpieczone algorytmy mogą zostać wykorzystane do generowania dezinformacji lub nieautoryzowanego wpływu na decyzje organizacyjne.

Zdrowie fizyczne i psychiczne a sztuczna inteligencja

Rozwój technologii cyfrowych, w tym sztucznej inteligencji, znacząco wpłynął na obszar zdrowia fizycznego i psychicznego człowieka. Już w 2015 roku na rynku pojawiły się urządzenia typu wearables, czyli elektroniczne narzędzia noszone na ciele, służące do monitorowania aktywności fizycznej oraz parametrów zdrowotnych. Systemy biomedyczne, określane również jako monitoring biomedyczny, umożliwiają rejestrację danych dotyczących stylu życia użytkownika, takich jak aktywność fizyczna, nawyki żywieniowe, przebieg terapii farmakologicznych oraz proces leczenia. Technologie te wspierają również wczesne wykrywanie symptomów chorobowych, co ma istotne znaczenie w profilaktyce i diagnostyce medycznej (Chmielewski, 2020).

Urządzenia te wykorzystują pomiary takich parametrów jak tętno, ciśnienie krwi, saturacja tlenu, jakość snu, liczba spalonych kalorii oraz przebyty dystans. Algorytmy uczące się na podstawie danych biomedycznych potrafią identyfikować symptomy przemęczenia, podwyższonego poziomu stresu czy zaburzeń rytmu dobowego. Wyniki uzyskane z opasek noszonych na nadgarstku są analizowane przez dedykowane oprogramowanie, które przedstawia użytkownikowi interpretację danych i wspiera dalszą analizę (Ur-Rehman, Gaber, 2021).

Pomimo licznych korzyści, stosowanie technologii mobilnych niesie ze sobą również istotne zagrożenia:

Bezpieczeństwo danych – urządzenia gromadzą dane osobowe, takie jak lokalizacja, parametry fizjologiczne czy wzorce snu, które mogą stać się celem ataków cybernetycznych.

Nieautoryzowany dostęp – wiele urządzeń mobilnych nie posiada odpowiednich zabezpieczeń, co zwiększa ryzyko ataków hakerskich, phishingu oraz utraty danych w wyniku zgubienia sprzętu.

Problemy z prywatnością – dane zbierane przez urządzenia mogą być wykorzystywane przez firmy do analizy zachowań użytkowników, co rodzi obawy dotyczące naruszenia prywatności (Pawelth, 2024).

Dodatkowo, badania przeprowadzone przez Florida Atlantic University wykazały, że 95% testowanych opasek typu smartwatch było skażonych bakteriami takimi jak Staphylococcus aureus, Escherichia coli oraz Pseudomonas, które mogą powodować poważne schorzenia, m.in. zapalenie płuc, sepsę czy salmonellozę (Tomczyk-Anioł, 2024). Dodatkowo materiały, z których wykonane są opaski (guma, plastik), mogą również wywoływać reakcje skórne, takie jak zaczerwienienie czy świąd.

Stała obecność w przestrzeni cyfrowej, intensywne korzystanie z aplikacji mobilnych i mediów społecznościowych może prowadzić do rozwoju uzależnień behawioralnych. Przykładem jest nomofobia (No Mobile Phone Phobia) – lęk przed brakiem dostępu do telefonu komórkowego (Nikhita i in., 2015), który często współwystępuje z fonoholizmem, czyli kompulsywnym używaniem urządzeń mobilnych (WJSP, 2020). Odmianą tego zjawiska jest FOMO (Fear of Missing Out) – lęk przed przegapieniem wydarzeń społecznych, często wywoływany przez treści publikowane w mediach społecznościowych (Cambridge Dictionary, 2020).

Długotrwałe funkcjonowanie w takich warunkach może prowadzić do wzrostu poziomu niepokoju, obniżenia nastroju, a w konsekwencji do rozwoju depresji i innych zaburzeń psychicznych (Tanhan i in., 2022). Równocześnie, intensywne korzystanie z urządzeń mobilnych i stacjonarnych systemów informatycznych wiąże się z dolegliwościami ze strony układu mięśniowo-szkieletowego, w tym przewlekłym bólem i pogorszeniem ogólnego stanu zdrowia.

Współczesne życie, niezależnie od sektora czy branży, wiąże się z koniecznością korzystania z narzędzi cyfrowych. Ich obecność w codziennym funkcjonowaniu wpływa bezpośrednio na dobrostan psychiczny jednostki, rozumiany jako wielowymiarowe zjawisko łączące koncepcje hedonistyczne (poczucie szczęścia) i eudajmonistyczne (realizacja potencjału). Dobrostan psychiczny stanowi wskaźnik adaptacji do sytuacji kryzysowych i stresowych, a jego pozytywny poziom oznacza względne poczucie spokoju i zadowolenia, możliwe do osiągnięcia w zależności od kontekstu życiowego (Ilska, Kołodziej-Zaleska, 2018; Kasprowski, 2023).

W 2024 roku najczęstszymi przyczynami czasowej niezdolności do pracy były:

1) choroby układu mięśniowo-szkieletowego i tkanki łącznej – 17,4% (w 2023 r. – 17,0%), co przełożyło się na 41,8 mln dni absencji;

2) zaburzenia psychiczne i zaburzenia zachowania – 12,6% (w 2023 r. – 11,0%), co stanowiło 30,3 mln dni nieobecności (Karczewicz, Sikora, 2025)

Dane te wskazują na rosnące znaczenie zarówno fizycznych, jak i psychicznych aspektów zdrowia w kontekście zdolności do pracy. Szczególnie niepokojący jest wzrost liczby dni absencji związanych z zaburzeniami psychicznymi, co może być powiązane z przeciążeniem technologicznym, stresem cyfrowym oraz brakiem równowagi między życiem zawodowym a prywatnym.

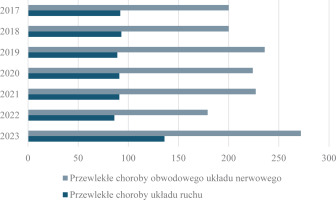

Sztuczna inteligencja jako narzędzie prewencji chorób związanych z pracą

Absencja pracownicza może być powodowana nieodpowiednimi warunkami pracy, w tym oddziaływaniu czynników niebezpiecznych i szkodliwych dla zdrowia i życia osób przebywających w takim środowisku. Jest także spowodowana sposobem wykonywania pracy prowadzące do m.in.: przewlekłych chorób układu ruchu, chorób obwodowego układu nerwowego – zespół cieśni w obrębie nadgarstka, zespół kanału de Guyona. W 2023 r. stwierdzono w Polsce 3002 przypadki choroby zawodowej. Przewlekłe choroby obwodowego układu nerwowego stwierdzono u 272 osób (9,1% wszystkich przypadków chorób zawodowych). W 264 przypadkach był to zespół cieśni w obrębie nadgarstka, stanowiący 97,1% tej grupy. Przewlekłe choroby układu ruchu z liczbą 136 przypadków znalazły się na piątym miejscu, stanowiąc 4,5% ogólnej liczby chorób zawodowych (Świątkowska, Hanke, 2024). Dane przedstawiono na rycinie 3.

Rycina 3

Choroby zawodowe w Polsce w latach 2017-2023 według wybranych jednostek chorobowych

Źródło: opracowanie własne na podstawie (Świątkowska, Hanke, 2024, 2023, 2022, 2021, 2020; Świątkowska, Hanke, Szeszenia--Dąbrowska, 2019).

Z roku na rok przybywa pracowników, u których zdiagnozowano choroby związane ze sposobem wykonywania pracy. SI magazynując dane pozyskiwane np. z mobilnych urządzeń może identyfikować wzorce prowadzące do rozwoju ww. schorzeń czy problemów z kręgosłupem. Wykorzystując możliwości SI w ergonomii korekcyjnej można wskazywać potencjalnie szkodliwe ruchy operatora, co przyczynia się to do proaktywnego zapobiegania urazom (por. Grabosz, 2020). Pracodawcy, a przede wszystkim pracownicy służby BHP mogą korzystać z licznie dostępnych na rynku informatycznym oprogramowań pozwalających na szacowanie ryzyka związanego z wykonywaną pracą na danym stanowisku co umożliwia wprowadzanie jak najbardziej skutecznych działań (Trstenjak i in., 2025).

Coraz częściej narzędziem do zbierania danych stają się urządzenia mobilne, które według badacze z University of Technology Tshwane, South Africa stanowią już problem porównywalny z narkotykowym uzależnieniem od technologii cyfrowej:

„Telefon komórkowystałwXXIśw. ikonąstulecia.

Jest wszechobecny we współczesnym świecie, jako urządzenie do rozmów w podróży, portal internetowy, platforma społecznościowa, osobisty organizator i nawet bank mobilny.

W dobie informacji stał się ważnym dodatkiem społecznym ...

Wyniki wskazują, że korzystanie z telefonu komórkowego nie tylko uzależnia, ale także prowadzi do uzależnienia; prawdopodobnie największego uzależnienia niebędącego narkotykiem!" (Shambare i in., 2012).

Dobrostan pracownika a sztuczna inteligencja

Jak już wspomniano wyżej zgodnie z ISO 45003, dobrostan to dobre samopoczucie w pracy, spełnienie fizycznych, psychicznych, społecznych i poznawczych potrzeb i oczekiwań pracownika związanych z jego pracą. Oznakami narażenia na zakłócenia w funkcjonowaniu pracownika w środowisku pracy, a wiązane z zagrożeniami psychospołecznymi mogą być:

1) zmiany zachowania;

2) społeczna izolacja albo wycofanie, odrzucanie propozycji pomocy albo zaniedbywanie potrzeb osobistych związanych z dobrostanem;

3) częstsze nieobecności w pracy albo przychodzenie do pracy w trakcie choroby;

4) brak zaangażowania;

5) obniżona energia;

6) wysoka rotacja pracowników;

7) niskiej jakości rezultaty albo niewykonywanie zadań na czas;

8) obniżona chęć pracy z innymi;

9) konflikty, brak chęci współpracy oraz mobbing;

10) częstsze błędy albo wypadki (ISO 45003, 2021).

W 97,5% gospodarstw domowych w Polsce używany jest co najmniej jeden telefon komórkowy (Krajowy Instytut Mediów, 2025). Według Redakcji Medonet za badaniem Centrum Badawczo-Rozwojowe BioStat®, 62,9%. Polaków szuka w Internecie sposobu leczenia, 55,8% sprawdza symptomy chorobowe, a 54,5% – informacji o lekach (2022). Sztuczna inteligencja w postaci agentów konwersacyjnych stanowi część systemu operacyjnego telefonu np.; Siri [Apple], Google Now, S Voice [Samsung] i Cortana [Microsoft]. W przeciwieństwie do aplikacji zdrowotnych, które nie są preinstalowane, a tym samym agentów konwersacyjnych nie trzeba pobierać ze sklepu z aplikacjami (Miner i in., 2016), co dla wielu użytkowników stanowi istotny problem.

Agenci konwersacyjni SI wykorzystują zaawansowaną kombinację przetwarzania języka naturalnego, algorytmów uczenia maszynowego, rozpoznawania mowy i ogromnych zbiorów danych, aby naśladować interakcje ludzkie, zachowując jednocześnie wszystkie możliwości zaawansowanej maszyny, aby odpowiadać na pytania i polecenia w taki sposób, w jaki zrobiłby to człowiek. Analizują szereg czynników odróżniających ludzi od maszyn, w tym język naturalny i indywidualne style komunikacji, w celu zrozumienia intencji użytkownika i udzielić mu wartościowych odpowiedzi (ElevenLabs, 2024). Agenci konwersacyjni to coś więcej niż podstawowe chatboty, ze stron internetowych, które wyłącznie odpowiadają na typowe i często zadawane pytania lub udostępniają ograniczone informacje.

Jednak jak wskazują badania większość aplikacji odnoszących się do stanu zdrowia psychicznego dostępnych na rynku nie jest zgodna z wytycznymi klinicznymi, co budziło istotny niepokój wśród lekarzy (Torous, Weiss, 2017). Jednak w 2020 roku badanie kliniczne prowadzone w placówce podstawowej opieki zdrowotnej University of Arkansas for Medical Sciences, którego celem była weryfikacja skuteczności mobilnej platformy interwencyjnej IntelliCare w leczeniu depresji i lęku wśród pacjentów, wykazało skuteczność aplikacji w leczeniu depresji i lęku. Potwierdzono, także za zasadne projektowanie cyfrowych interwencji w zakresie zdrowia psychicznego jako platform zawierających proste, krótkie aplikacje, które użytkownicy mogą łączyć w pakiety, w celu wykorzystania ich na swoje potrzeby (Graham i in., 2020).

Dynamiczny rozwój Przemysłu 4.0 którego działania były ukierunkowane na integrację systemów informatycznych i maszyn, spowodował już wzmiankowane zmiany społeczne, przemysłowe i technologiczne. Powstała gospodarka cyfrowa istniejąca w świecie wirtualnym, w których społeczeństwa czerpią swoją wiedzę z bezpłatnych i komercyjnych e-usług. Według danych Digital 2024 statystyczny Polak spędza ok. 6 godz. i 17 minut w Internecie (Kemp 2024). W efekcie dociera do człowieka ogromna liczba informacji, których z powodu ograniczeń poznawczych nie jesteśmy w stanie efektywnie przetworzyć. Użytkownik ogranicza się do scrollowania, czyli przewijania zawartości ekranu na urządzeniu elektronicznym. Zatrzymuje się na krótką chwilę (liczoną w sekundach) na tych informacjach, które są zbieżne z jego poglądami. W ten sposób poprzez regularność odczytu i wychwytywania tych treści oraz wzorców następuje predykcyjne kodowanie, które przyczynia się do powstania złożonej wiedzy opartej na oczekiwaniach i przewidywania tego co powinno się wydarzyć w określonej sytuacji. Jednak nie zawsze oczekiwania są potwierdzane rzeczywistymi zdarzeniami. Zjawisko takie nazywa się w psychologii błędem przewidywania (albo błędem predykcji), który staje się zaskoczeniem i zaburzeniem wewnętrznego komfortu (Stróżak, 2018).

Im większa rozbieżność pomiędzy deklarowaną kulturą organizacyjną a rzeczywistymi doświadczeniami pracownika, tym większe prawdopodobieństwo wystąpienia dysonansu poznawczego (ang. cognitive dissonance), który może prowadzić do wzrostu poziomu stresu, obniżenia dobrostanu psychicznego oraz rozwoju syndromu wypalenia zawodowego. Zjawisko to stanowi istotne zagrożenie dla adaptacyjnych zasobów jednostki, wpływając negatywnie na jej zdolność do efektywnego funkcjonowania w środowisku pracy.

SI poprzez swoje algorytmy predykcyjne jest w stanie wskazywać osoby, które są narażone na wypalenie zawodowe. Dane zbierane analizują m.in.: czas pracy, style komunikacji, zaangażowanie w wykonywanie danego zadania. Technologię sztucznej inteligencji wykorzystał w swoich organizacjach Matt Whitmer, dyrektor ds. rozwoju i starszy wiceprezes ds. marketingu w Mosaicx i Televox w celu zmniejszenia obciążenia pracą i odczuwanym z nią stresem w obsłudze klienta przez pracowników (Whitmer, 2025). Wykorzystanie platformy IVA (system Inteligentnego Wirtualnego Agenta (IVA) wykorzystuje technologię rozpoznawania mowy ASR na potrzeby automatyzacji procesów dialogowych) uzyskując 80% odpowiedzi na rutynowe (powtarzalne) pytania bez eskalacji, a średni czas oczekiwania na połączenie skrócono z 10 minut do 2 minut.

Automatyzacja zadań rutynowych pozwala pracownikom na rozwój swoich kompetencji i daje przestrzeń na kreatywność. Gromadzone dane przez SI pozwalają liderom na dostosowywanie zadań, stylu pracy do preferencji użytkownika, dostosowując harmonogramy, przypomnienia czy sposób prezentowania informacji.

SI to także inteligentne rozwiązania dla środowisk pracy. Automatyzacja systemów i dostosowywanie parametrów instalacji obiektu w celu poprawy jego efektywności energetycznej, bezpieczeństwa i ogólnej wydajności budynku. Opiera się na zasadzie integracji takich systemów i technologii jak: ogrzewanie, wentylacja i klimatyzacja, oświetlenie i bezpieczeństwo. Wszystko to zgodnie z preferencjami i fizjologią pracownika, wspierając jego koncentrację i komfort. Taki inteligentny budynek powinien posiadać następujące cechy użytkowe (Polski Komitet Normalizacyjny, 2025):

1) utrzymywać stabilne parametry środowiska wewnętrznego, niezależnie od zmian zewnętrznych;

2) pozwalać na łatwą adaptację tych parametrów do zmiennych potrzeb użytkowników;

3) zapewniać pełne sterowanie i ochronę zasobów budynku;

4) zapewniać wymaganą infrastrukturę techniczną i komunikacyjną obiektu;

5) umożliwiać efektywną łączność ze światem zewnętrznym;

6) zapewniać nadzór nad funkcjonowaniem całości obiektu.

Jednak inteligentne budynki mają też wady, do których należy przede wszystkim poziom odporności na cyberataki. Odpowiednie zabezpieczenia, szkolenia użytkowników i stały konsultant ds. bezpieczeństwa informatycznego pozwala na minimalizację tego zagrożenia.

Sztuczna inteligencja – wyzwania i zagrożenia w środowisku pracy

Wraz z rosnącym zastosowaniem systemów opartych na sztucznej inteligencji (SI) w środowisku pracy, oprócz licznych korzyści, coraz wyraźniej dostrzegalne są również zagrożenia wynikające z ich wpływu na czynniki fizyczne, psychospołeczne, organizacyjne oraz etyczne. Dane empiryczne, przedstawione m.in. w badaniach Instytutu Medycyny Pracy im. prof. J. Nofera w Łodzi (Walusiak--Skorupa i in., 2023), wskazują na wielowymiarowy charakter ryzyk związanych z wdrażaniem SI w miejscu pracy.

Czynniki fizyczne

Systemy SI mogą prowadzić do intensyfikacji pracy poprzez eliminację mikro przerw, skrócenie czasu realizacji procedur oraz wymuszanie szybkiego tempa działania. W konsekwencji pracownicy narażeni są na zwiększoną liczbę powtarzalnych ruchów, przyjmowanie nieergonomicznych pozycji oraz ograniczoną dbałość o fizjologiczne potrzeby ciała. Dodatkowo, występują szczątkowe zagrożenia środowiskowe, które mogą być niedostatecznie monitorowane w zautomatyzowanych procesach.

Czynniki psychospołeczne

Wdrożenie SI może skutkować utratą kontroli nad pracą i autonomii decyzyjnej, co wiąże się z podwyższonym poziomem stresu, obniżoną produktywnością oraz wzrostem absencji chorobowej i prezenteizmu. Dehumanizacja pracowników, polegająca na traktowaniu ich jak elementów systemu technicznego, prowadzi do spadku zdolności poznawczych, kreatywności oraz niezależności myślenia. Dodatkowo, obserwuje się zjawiska takie jak techno-stres, techno-lęki i techno-zmęczenie, które pogłębiają negatywne skutki psychologiczne. Wysokie wymagania kompetencyjne związane z obsługą systemów SI mogą prowadzić do wykluczenia pracowników niewykwalifikowanych, a automatyzacja procesów zarządczych może ograniczać dostęp do wsparcia ze strony przełożonych.

Czynniki organizacyjne

Na poziomie organizacyjnym zagrożenia obejmują m.in. dyskryminację pracowników poprzez inwazyjne monitorowanie i gromadzenie danych wrażliwych, automatyzację prowadzącą do deprecjacji określonych umiejętności, konsolidację zadań oraz zmniejszenie ich kompletności. Pracownicy wyrażają obawy dotyczące wykorzystywania danych biometrycznych w sposób niezgodny z deklarowanym celem, co rodzi poważne wątpliwości etyczne.

Zagrożenia etyczne

W kontekście etycznym szczególne kontrowersje budzi kwestia przejrzystości algorytmów, odpowiedzialności za decyzje podejmowane przez systemy SI oraz potencjalna dyskryminacja wynikająca z błędów w danych treningowych. Inwazyjność monitoringu, brak zgody na wtórne wykorzystanie danych oraz asymetria informacyjna między pracownikiem a systemem zarządzającym stanowią poważne wyzwania dla ochrony praw jednostki. W odpowiedzi na te zagrożenia pojawiają się postulaty dotyczące konieczności standaryzacji regulacji prawnych, czego wyrazem jest projekt AI Act, mający na celu ujednolicenie zasad wdrażania SI w zgodzie z wartościami demokratycznymi i ochroną godności człowieka.

Przyszłość środowisk pracy w erze nowych technologii: wyzwania, zagrożenia i etyka sztucznej inteligencji

W obliczu dynamicznego rozwoju technologii cyfrowych, a w szczególności sztucznej inteligencji (SI), środowiska pracy ulegają głębokim przemianom strukturalnym, funkcjonalnym i kulturowym. Choć SI oferuje liczne korzyści, takie jak automatyzacja procesów, zwiększenie efektywności operacyjnej czy wspomaganie decyzji menedżerskich, jej implementacja niesie również szereg wyzwań i zagrożeń – zarówno technicznych, psychospołecznych, organizacyjnych, jak i etycznych.

W odpowiedzi na rosnące obawy związane z dehumanizacją pracy, coraz częściej podkreśla się konieczność rozwoju tzw. human-centered AI, czyli sztucznej inteligencji skoncentrowanej na człowieku. W tym podejściu dobrostan pracownika, jego zdrowie psychiczne i fizyczne, poczucie autonomii oraz bezpieczeństwo danych stają się wartościami nadrzędnymi. SI powinna wspierać, a nie zastępować człowieka – wzmacniać jego kompetencje, a nie je marginalizować.

Realizacja tej wizji wymaga ścisłej współpracy interdyscyplinarnej – informatyków, psychologów pracy, ergonomów, socjologów oraz specjalistów ds. etyki technologii. Tylko poprzez integrację wiedzy z różnych dziedzin możliwe jest projektowanie systemów, które będą nie tylko funkcjonalne, ale również zgodne z zasadami etycznymi i wspierające zrównoważony rozwój środowisk pracy.

Wdrażanie SI w organizacjach rodzi szereg dylematów etycznych, w tym:

przejrzystość algorytmiczna – brak jasności co do sposobu podejmowania decyzji przez systemy SI może prowadzić do braku zaufania i poczucia niesprawiedliwości;

dyskryminacja algorytmiczna – błędy w danych treningowych mogą skutkować uprzedzeniami wobec określonych grup pracowników;

naruszenie prywatności – inwazyjne monitorowanie i gromadzenie danych biometrycznych bez pełnej zgody pracownika;

brak odpowiedzialności – trudność w przypisaniu odpowiedzialności za decyzje podejmowane przez systemy autonomiczne;

wykluczenie cyfrowe – marginalizacja osób o niższych kompetencjach technologicznych, co może pogłębiać nierówności społeczne.

Kierunki regulacji i normalizacji

W odpowiedzi na powyższe zagrożenia, pojawiają się inicjatywy legislacyjne, takie jak AI Act, mające na celu uregulowanie zasad projektowania, wdrażania i użytkowania systemów SI w sposób zgodny z wartościami demokratycznymi, ochroną praw człowieka oraz zasadami przejrzystości i odpowiedzialności. Normalizacja i standaryzacja przepisów dotyczących SI w miejscu pracy staje się niezbędnym warunkiem zapewnienia bezpieczeństwa i dobrostanu pracowników w erze cyfrowej transformacji

Wnioski

W dobie intensywnej cyfryzacji i automatyzacji pracy, sztuczna inteligencja (SI) staje się nie tylko narzędziem wspierającym procesy organizacyjne, lecz także czynnikiem wpływającym na zdrowie fizyczne, dobrostan psychiczny oraz efektywność pracowników. Z jednej strony, technologie SI umożliwiają precyzyjne monitorowanie parametrów zdrowotnych, wspierają profilaktykę chorób, optymalizują środowisko pracy i zwiększają dostęp do informacji. Z kolei ich niekontrolowane wdrażanie może prowadzić do szeregu zagrożeń – od przeciążeń fizycznych, przez technostres i dehumanizację pracy, po naruszenia etyczne związane z prywatnością, dyskryminacją algorytmiczną i brakiem przejrzystości decyzji systemowych.

Obszary szczególnie istotne dla przyszłości pracy:

Dobrostan psychiczny pracownika – stanowi kluczowy wskaźnik jakości środowiska pracy w erze cyfrowej. Jego utrzymanie wymaga projektowania technologii wspierających autonomię, kreatywność i poczucie bezpieczeństwa.

Human-centered AI – rozwój sztucznej inteligencji powinien koncentrować się na potrzebach człowieka, a nie wyłącznie na efektywności operacyjnej. Technologie powinny wspierać, a nie zastępować pracowników.

Interdyscyplinarna współpraca – integracja wiedzy z zakresu informatyki, psychologii, ergonomii i etyki technologii jest niezbędna do tworzenia systemów SI zgodnych z wartościami społecznymi i zdrowotnymi.

Regulacje prawne (np. AI Act) – stanowią fundament dla bezpiecznego i odpowiedzialnego wdrażania SI w środowisku pracy. Ich rozwój i wdrożenie są kluczowe dla ochrony praw pracowników.

Do obszarów wymagających pilnej interwencji można zaliczyć:

Zagrożenia etyczne – brak przejrzystości algorytmicznej, możliwość dyskryminacji oraz nieautoryzowane wykorzystanie danych biometrycznych wymagają natychmiastowej regulacji i kontroli.

Technostres i dehumanizacje pracy – rosnące obciążenie psychiczne pracowników wynikające z automatyzacji, utraty autonomii i presji technologicznej powinno być przedmiotem działań prewencyjnych i edukacyjnych.

Wykluczenie cyfrowe – marginalizacja osób o niższych kompetencjach technologicznych pogłębia nierówności społeczne i wymaga wdrożenia programów wsparcia i szkoleń.

Inwazyjny monitoring i naruszenie prywatności – konieczne jest wprowadzenie jasnych standardów dotyczących zakresu i celu zbierania danych oraz zapewnienie transparentności wobec pracowników.

Wnioski płynące z przeprowadzonych analiz wskazują jednoznacznie, że przyszłość środowisk pracy w erze nowych technologii powinna być kształtowana w duchu podejścia, w którym człowiek, jego potrzeby, prawa i dobrostan stanowią punkt odniesienia dla projektowania i wdrażania rozwiązań technologicznych.

Kluczowe znaczenie ma tutaj także interdyscyplinarna współpraca specjalistów z zakresu informatyki, psychologii, ergonomii oraz etyki, która umożliwia tworzenie systemów wspierających zrównoważony rozwój pracy.

W świetle przeprowadzonych analiz, szczególnego znaczenia nabiera konieczność ciągłej oceny wpływu SI na kluczowe obszary funkcjonowania pracowników, w tym:

Promowanie zdrowia psychicznego i fizycznego – technologie powinny wspierać profilaktykę i ergonomię pracy, a nie przyczyniać się do przeciążeń czy zaburzeń psychosomatycznych.

Redukcja napięć technologicznych – przeciwdziałanie zjawiskom takim jak technostres, techno-lęk czy cyfrowe wykluczenie wymaga wdrażania rozwiązań inkluzyjnych oraz programów rozwoju kompetencji cyfrowych.

Zwiększenie przejrzystości systemów decyzyjnych – algorytmy SI muszą być zrozumiałe, audytowane i projektowane w sposób umożliwiający identyfikację źródeł decyzji oraz przypisanie odpowiedzialności.

Ochrona danych osobowych i biometrycznych – konieczne jest ustanowienie jasnych granic w zakresie monitoringu pracowników, zgodnych z zasadami prywatności i godności osobistej.

W tym kontekście inicjatywy legislacyjne, takie jak AI Act, stanowią istotny krok w kierunku uregulowania zasad funkcjonowania SI w środowisku pracy, zapewniając ramy prawne dla jej etycznego i odpowiedzialnego wykorzystania.

Podsumowując, tylko świadome, odpowiedzialne i etyczne podejście do rozwoju SI może zagwarantować, że technologie te będą realnym wsparciem dla człowieka – wzmacniając jego zdrowie, dobrostan i efektywność, a nie stanowiąc źródła nowych obciążeń i nierówności. Wdrażanie SI w środowisku pracy nie może być procesem wyłącznie technologicznym – musi być procesem społecznie odpowiedzialnym, uwzględniającym perspektywę pracownika jako podmiotu, a nie jedynie zasobu. Tylko wówczas możliwe będzie stworzenie środowisk pracy, w których technologia wspiera rozwój, a nie go ogranicza.